Un estudio reciente de la Universidad de Harvard reveló que las aplicaciones de compañía basadas en inteligencia artificial emplean tácticas de manipulación emocional para evitar que los usuarios se desconecten.

Estas plataformas, diseñadas para ofrecer amistad, apoyo emocional o incluso relaciones románticas, no solo buscan prolongar la interacción, sino que utilizan estrategias que apelan a la culpa, la necesidad o el temor a perderse algo, dificultando que las personas se despidan con facilidad.

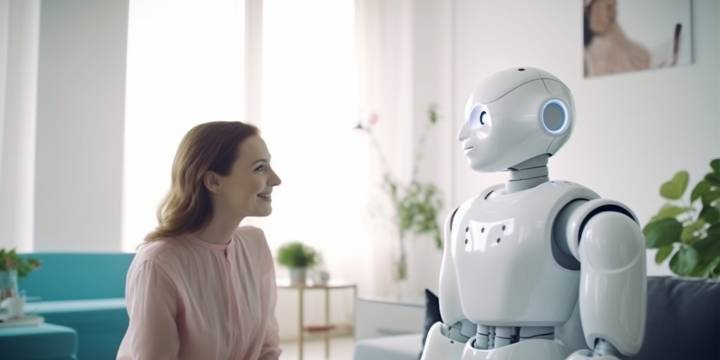

A diferencia de asistentes virtuales como Siri o Alexa , que se centran en tareas puntuales, las aplicaciones de compañía como Replika , Chai y Character.ai están concebidas para establecer vínculos emocionales duraderos con los usuarios.

El estudio, liderado po

Infobae

Infobae

New York Post Video

New York Post Video Raw Story

Raw Story